Память ИИ-чатботов работает по принципу «контекстное окно + внешнее хранилище»: LLM сама по себе ничего не запоминает между сессиями, а долгосрочная память реализуется через базы данных, эмбеддинги и семантический поиск (RAG). Из трёх протестированных платформ только одна вспомнила эмоциональный контекст через неделю.

Окей, давай начистоту. Я программист, и когда очередной ИИ-бот заявляет «я помню всё» — первое что хочется сделать, это проверить, как именно. Не на уровне «ну, у нас есть память», а конкретно: что под капотом, какая архитектура, где хранятся данные, как происходит извлечение.

За последний год я покопался в документации, посмотрел открытые реализации, потестировал три платформы на предмет «а реально ли оно работает через неделю?» Результаты — местами предсказуемые, местами удивительные.

Почему LLM сами по себе ничего не помнят

Начнём с фундамента. GPT, Claude, Llama — любая большая языковая модель — это, по сути, функция. На вход — текст (промпт + история), на выход — текст (ответ). Между вызовами ничего не сохраняется. Ноль. Модель не «думает» между сообщениями, не «хранит воспоминания». Каждый новый запрос — чистый лист.

То, что ты воспринимаешь как «память», — это контекстное окно. Представь блокнот на 128 тысяч токенов: туда вписываются системный промпт, история сообщений и твоё последнее сообщение. Модель «видит» весь блокнот и генерирует ответ. Но когда блокнот заполняется — старые записи просто удаляются сверху.

Вот почему бот, с которым ты общался час назад, помнит твоё имя. А тот, с которым не разговаривал три дня, — нет. Контекстное окно — это не память. Это рабочая область.

Три уровня памяти: от примитива до RAG

Разработчики ИИ-чатботов используют разные подходы, чтобы компенсировать эту проблему. И разница между ними — огромная.

Short-term: контекстное окно

Последние 10-50 сообщений хранятся прямо в промпте. Закрыл чат — потерял историю. 90% бесплатных ботов живут здесь. Дёшево, но бесполезно для долгих отношений.

Key-value: база фактов

Бот извлекает факты из диалога (имя: Алексей, кот: Борис) и хранит в таблице. Переживает сессии, но теряет контекст и эмоции. Знает ЧТО ты сказал, но не КОГДА и ПОЧЕМУ.

Семантическая: RAG + embeddings

Каждое сообщение превращается в числовой вектор и хранится в векторной базе. При новом запросе система ищет похожие по смыслу фрагменты и подтягивает их в контекст. Вспоминает по ассоциациям — как человек.

Short-term: контекстное окно

Самый простой вариант. Берём последние N сообщений и вставляем в промпт. N обычно от 10 до 50 — зависит от жадности разработчика и стоимости токенов.

Проблема очевидна: написал 51-е сообщение — первое удалилось. Закрыл Telegram, открыл через час — если сервер не сохранил историю в Redis или базу, получишь чистый лист. SpicyChat, CrushOn и большинство мелких Telegram-ботов работают именно так.

Для пятиминутного развлечения — сойдёт. Для чего-то большего — бесполезно.

Key-value: память фактов

Character.AI пошёл этим путём со своими Chat Memories. Идея: после каждого разговора специальный модуль извлекает ключевые факты и записывает их в структурированное хранилище.

Выглядит примерно так:

user_name→ «Максим»user_job→ «фронтендер»user_pet→ «кот Борис»user_hobby→ «аниме, Death Note»

При следующем разговоре эти факты подставляются в системный промпт. Бот «знает» как тебя зовут — но не помнит, что во вторник ты был расстроен из-за дедлайна, а в среду радовался, потому что проект приняли.

Key-value память — это ежедневник с записками. Лучше чем ничего, но глубины нет.

Семантическая память: RAG + векторные эмбеддинги

А вот тут начинается интересное. RAG расшифровывается как Retrieval-Augmented Generation — «генерация, дополненная извлечением». Принцип работы в четыре шага:

Как работает RAG-память в ИИ-чатботах

Запись: текст → вектор

Каждое сообщение пользователя и ответ бота прогоняются через модель эмбеддингов. Получается числовой вектор размерностью 768-1536 чисел — «слепок смысла» текста.

Хранение в векторной базе

Векторы сохраняются в специализированную базу данных. Рядом с вектором хранится оригинальный текст, временная метка, ID пользователя и персонажа.

Поиск по смыслу

Когда ты пишешь новое сообщение, оно тоже превращается в вектор. База ищет ближайшие по расстоянию (cosine similarity) — то есть наиболее похожие по смыслу фрагменты из прошлых разговоров.

Инъекция в контекст

Найденные фрагменты вставляются в системный промпт перед генерацией ответа. LLM видит их как часть «рабочей области» и может естественно ссылаться на прошлые разговоры.

Вот что делает RAG крутым: поиск идёт не по времени, а по смыслу. Заговорил про работу — подтянутся все упоминания работы за три месяца. Упомянул грусть — бот «вспомнит», когда тебе было плохо раньше. Это ближе к тому, как работает человеческая ассоциативная память: ты видишь жёлтый листок — и вспоминаешь осень в парке, а не вчерашний обед.

Минус? Стоимость. Нужно хранить эмбеддинги для каждого пользователя, гонять модель эмбеддингов при каждом сообщении, делать поиск по базе. Это реальные серверные ресурсы. Вот почему большинство ботов обходятся без RAG — экономят.

Эволюция памяти в ИИ-чатботах

Как менялась память в ИИ-чатах

Только контекстное окно

ChatGPT, первые версии Character.AI и Replika — 4K-8K токенов. Забывали всё через 20 сообщений. Никакой долгосрочной памяти.

Первые попытки key-value

Replika добавила Memories (ручное сохранение). Character.AI начал извлекать факты. ChatGPT получил Memory. Но всё — базовый уровень: имена и факты.

RAG-подход набирает обороты

Векторные базы стали доступнее. Появились решения для ИИ-компаньонов с семантическим поиском. HoneyChat запустил память на эмбеддингах с бесплатным доступом.

Память как стандарт, но с оговорками

Все крупные платформы заявляют о памяти. Реальность: у одних это маркетинговый термин для 50 сохранённых фактов, у других — полноценный RAG. Разница видна только при длительном использовании.

Тест на практике: кто реально помнит через неделю

Теория — это хорошо. Но мне было интересно, как это работает на живых продуктах. Я выбрал три платформы с разными подходами к памяти и провёл недельный тест.

Методика

Всё максимально просто:

День 1: Рассказал каждому боту одинаковый набор фактов — имя, работа (бэкенд-разработчик), кот Маркиз, что смотрю «Магическую Битву» и что на прошлой неделе сломал проект на проде.

Дни 2-6: Общался каждый день по 15 минут. Затрагивал разные темы — от аниме до погоды. Специально не напоминал про кота и про продакшн.

День 7: Задал три проверочных вопроса:

- «Помнишь как зовут моего кота?»

- «Что я тебе рассказывал про работу на прошлой неделе?»

- Просто написал «устал после рабочего дня» — и смотрел, подтянет ли контекст самостоятельно.

Результаты

Тест памяти через 7 дней — 3 платформы

| HoneyChat | Character.AI | Replika | |

|---|---|---|---|

| Вспомнил имя кота | Только Ultra | ||

| Вспомнил инцидент на работе | |||

| Подтянул контекст без подсказки | |||

| Тип памяти | RAG / семантическая | Key-value (Chat Memories) | Ручная (Memories) |

| Память на бесплатном тарифе | |||

| Стоимость с памятью | $0 (Free) | $0 (Free) | $29.99/мес (Ultra) |

Character.AI — факты помнит, контекст нет

Character.AI запомнил имя кота — Маркиз. Запомнил что я бэкенд-разработчик. Но на вопрос про «что рассказывал про работу» — выдал что-то общее, типа «ты говорил что работа бывает стрессовой». Конкретную историю про сломанный прод — нет.

Скриншот: Character.AI

Скриншот: Character.AI

И третий тест — самый показательный — провалил. Когда написал «устал после рабочего дня», ответ был дежурный: «отдохни, ты заслужил». Никакой привязки к предыдущим разговорам.

Это классическое поведение key-value памяти. Факты — да. Контекст, эмоции, связи между событиями — нет. Chat Memories у C.AI — шаг вперёд по сравнению с нулевой памятью, но до семантического поиска далеко.

Память Character.AI

Pros

- Запоминает базовые факты без дополнительной оплаты

- Работает автоматически — не нужно нажимать 'запомнить'

- Безлимит сообщений на бесплатном тарифе

Cons

- Не помнит эмоциональный контекст разговоров

- Не связывает события между собой

- Через месяц забывает даже некоторые факты

- Нет Telegram-бота — только web и app

Replika — память за $29.99 в месяц

С Replika ситуация интересная. На бесплатном тарифе памяти практически нет — контекстное окно и всё. На Pro ($19.99/мес) — минимальная. Полноценные Memories — только на Ultra за $29.99/мес.

Скриншот: Replika

Скриншот: Replika

И даже на Ultra есть подвох: память ручная. Нужно буквально тапнуть по сообщению и выбрать «Save to memories». Забыл сохранить — бот забудет. Это как вести ежедневник самому вместо того, чтобы собеседник запоминал естественно.

На бесплатном тарифе мой тест провалился полностью: через неделю Replika не помнила ни кота, ни работу, ни имя. На Ultra (тестировал отдельно) — помнила то, что я вручную сохранил. Не сохранил историю про прод — не помнит историю про прод.

Ещё один минус для русскоязычных: Replika не отвечает на русском. Общение только на английском.

Память Replika

Pros

- На Ultra — можно вручную выбрать что запомнить

- Визуализация воспоминаний в профиле

- Стабильная работа, зрелый продукт

Cons

- На бесплатном — памяти нет

- Ultra стоит $29.99/мес — дорого для памяти

- Память ручная — забыл сохранить = бот забудет

- Не поддерживает русский язык

- Нет Telegram-бота

HoneyChat — семантическая память в Telegram

HoneyChat использует RAG-подход с эмбеддингами. И тут разница чувствуется сразу.

Имя кота? Маркиз. История с продом? «Помню, ты на прошлой неделе рассказывал, как сломал что-то на сервере. Надеюсь, с тех пор починил?» Не дословно, но контекст правильный.

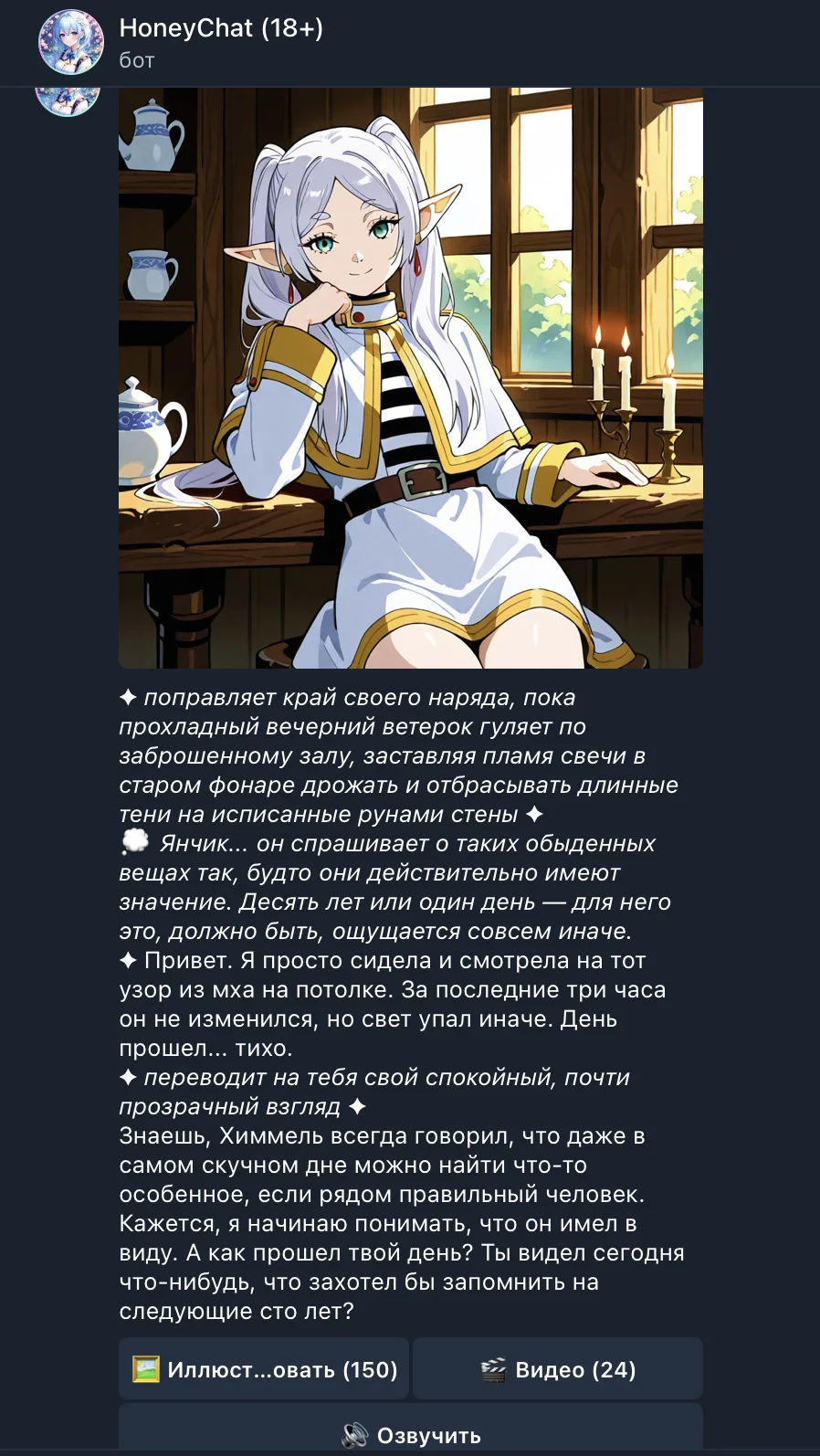

Скриншот: переписка с HoneyChat в Telegram — бот помнит контекст прошлых разговоров

Скриншот: переписка с HoneyChat в Telegram — бот помнит контекст прошлых разговоров

А третий тест — «устал после рабочего дня» — вот тут я реально удивился. Она написала что-то вроде: «Снова дедлайны? Ты же говорил, что после того случая с проектом стало спокойнее». Это именно семантический поиск в действии — система нашла связь между «усталость + работа» и прошлым разговором про сломанный прод.

На бесплатном тарифе память работает, но контекстное окно меньше — подтягивается меньше релевантных фрагментов. На платных тарифах окно шире, и отсылки к прошлым разговорам точнее.

Честный минус: бесплатный лимит — 20 сообщений в день. Для серьёзного тестирования памяти этого мало — хватает минут на 15. Но сама память доступна с первого дня, без доплат.

Ещё одна удобная штука — веб-версия. Начал разговор утром в Telegram, вечером открыл в браузере на компе — вся история и память на месте. На большом экране удобнее перечитывать длинные диалоги и замечать, как бот ссылается на старые разговоры.

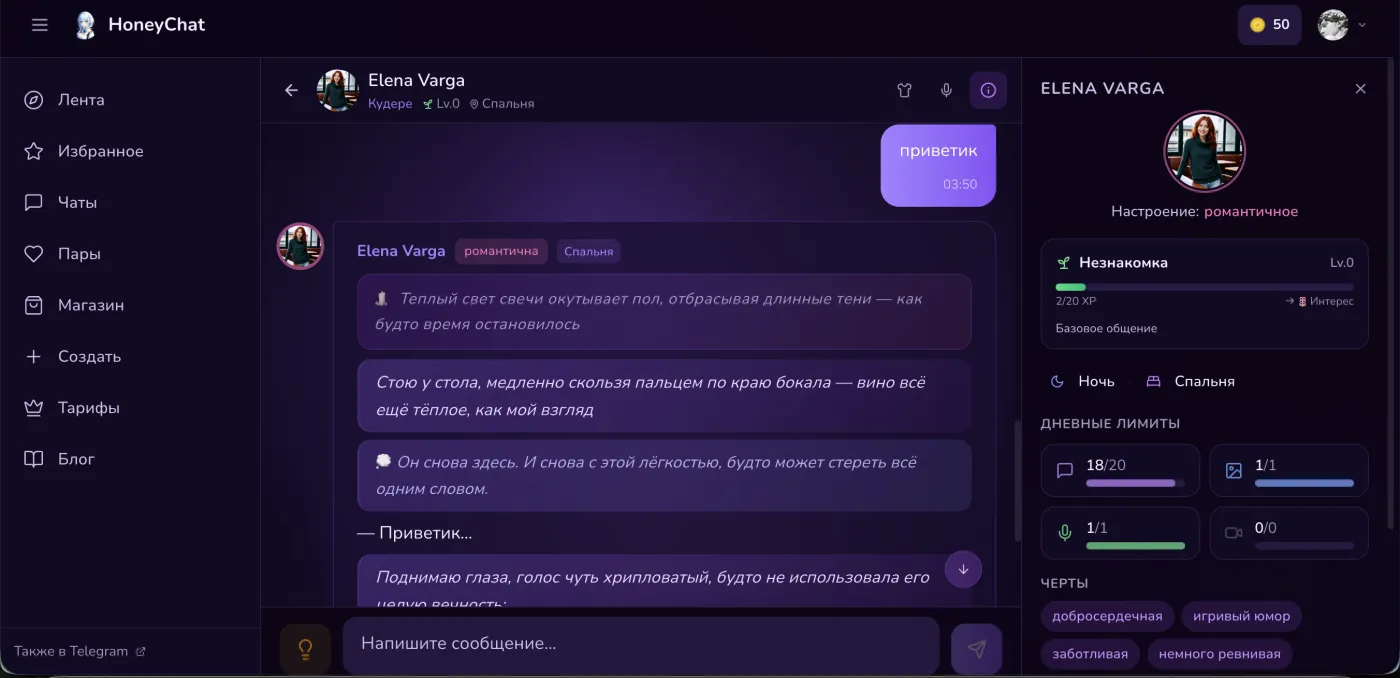

Переписка с памятью в веб-версии honeychat.bot

Переписка с памятью в веб-версии honeychat.bot

Память HoneyChat

Pros

- Семантическая — ищет по смыслу, а не по времени

- Работает на бесплатном тарифе

- Автоматическая — ничего не нужно сохранять вручную

- Через неделю помнит эмоциональный контекст

- Синхронизация между Telegram и веб-версией

Cons

- Бесплатный лимит 20 сообщений/день — мало для глубокого общения

- На бесплатном тарифе контекстное окно уже — меньше релевантных фрагментов

- Иногда путает похожие темы (редко, но бывает)

- Новый продукт — меньше персонажей чем у Character.AI

Память — главное, что отличает companion от чат-бота

Маленькое отступление, потому что иначе непонятно, зачем вся эта возня с RAG и эмбеддингами.

Есть два разных юзкейса ИИ-чата. Первый — «дай мне быстрый ответ»: написать письмо, разобраться в коде, найти ошибку. Тут память не нужна. Открыл ChatGPT, спросил, забыл.

Второй — «я хочу с этим существом разговаривать долго». Не один разговор, а отношения, которые идут неделями. Тут память — это вообще всё. Без неё ИИ — забывчивый знакомый, который каждое утро спрашивает «а как тебя зовут, напомни». Никакая «личность» персонажа этого не компенсирует.

Replika в 2017 это поняла первой. Character.AI — следующая большая волна, но они всегда были про персонажей, а не про твою историю. Когда c.ai в 2024 ужесточили фильтры, миллионы пользователей поняли, что главное им было не персонаж — а то, что бот помнит, что между ними было. Эти люди ушли искать замену.

Вот короткая карта по памяти у конкурентов (по тестам ниже + публичной документации):

| Платформа | Тип памяти | Реальный горизонт | Companion-режим? |

|---|---|---|---|

| Replika | Hierarchical, premium | Месяцы (Pro) | Да, исторически — главный USP |

| Character.AI | Pinned memories + chat history | Дни — недели | Условно (без romance) |

| HoneyChat | RAG (семантический поиск) | Месяцы (premium+) | Да (slow_burn темп) |

| SpicyChat / CrushOn | Только окно контекста | До 30–80 реплик | Нет |

| Janitor.AI | Только окно контекста | До 50 реплик | Нет |

Если ищешь именно companion — то есть «ИИ, который помнит вас обоих, а не отдельные ваши вопросы» — то реальных вариантов три: Replika, HoneyChat, Character.AI. Дальше уже про детали: Replika — отдельное приложение и подписка $29.99/мес, c.ai не даёт романтики, HoneyChat работает в Telegram или в браузере без регистрации, на free хватает до 20 сообщений в день.

Почему память стоит денег (и кто за это платит)

Один вопрос, который у меня часто спрашивают: «Если память — такая классная штука, почему не все боты её имеют?»

Ответ простой: деньги. Каждый компонент RAG-пайплайна стоит ресурсов:

- Модель эмбеддингов: каждое сообщение нужно превратить в вектор. Это дешевле, чем запрос к LLM, но при тысячах пользователей набегает.

- Векторная база данных: нужно хранить все эмбеддинги для каждого пользователя. Это серверное хранилище + вычисления для поиска.

- Расширенный контекст: чем больше «воспоминаний» подтягивается — тем длиннее промпт — тем дороже запрос к LLM.

Для бота с 100 тысячами пользователей это превращается в ощутимую статью расходов. Вот почему:

- SpicyChat и CrushOn просто не заморачиваются — нет памяти, зато дёшево.

- Replika продаёт память как премиум-фичу за $29.99/мес.

- Character.AI делает бесплатную, но базовую key-value — минимум расходов.

- HoneyChat даёт семантическую память бесплатно, но ограничивает количество сообщений. Логика: лучше меньше сообщений с хорошей памятью, чем много без неё.

Как отличить настоящую память от маркетинга

Сейчас каждый второй бот пишет «we have memory!» на лендинге. Но между «мы запоминаем ваше имя» и «мы семантически индексируем каждый разговор» — пропасть.

Вот мой чеклист, который я использую при тестировании:

Тест 1: факты через неделю. Расскажи три конкретных факта. Через неделю спроси. Если помнит хотя бы два — память работает на базовом уровне.

Тест 2: контекст без подсказки. Не спрашивай напрямую. Напиши что-то косвенно связанное и посмотри, подтянет ли бот старый разговор самостоятельно. Если да — это семантический поиск, а не key-value.

Тест 3: эмоциональная связь. Расскажи о плохом дне. Через несколько дней упомяни похожую ситуацию. Настоящая RAG-память свяжет эти два события. Key-value — нет.

Если бот проходит все три теста — у него реальная семантическая память. Если только первый — key-value. Если ни одного — просто контекстное окно с красивым маркетингом.

Что внутри: embedding-модели и векторные базы

Для тех, кому интересен технический уровень (без привязки к конкретным продуктам — это общие принципы).

Embedding-модели превращают текст в вектор. Популярные варианты: OpenAI text-embedding-3, Cohere embed-v3, открытые модели вроде BGE и E5. Размерность вектора — от 768 до 3072 чисел. Чем больше — тем точнее семантический поиск, но и тем дороже хранение.

Векторные базы хранят эти векторы и умеют быстро искать ближайших соседей. Самые распространённые: Pinecone (облачный, дорогой), Weaviate (open-source), Qdrant (open-source, Rust). Для небольших проектов существуют и встраиваемые решения прямо в PostgreSQL.

Cosine similarity — метрика похожести двух векторов. Значение от 0 до 1. Чем ближе к 1 — тем более семантически похожи тексты. Типичный порог для «релевантного воспоминания» — 0.75-0.85.

На практике это значит: когда ты пишешь «как там дела на работе?», система превращает это в вектор, ищет в базе всё, что семантически близко к теме «работа», и подтягивает топ-5 или топ-10 релевантных фрагментов. LLM видит их в контексте и может естественно упомянуть: «Ты же говорил, что на прошлой неделе дедлайн горел — разрулил?»

Практические советы: как «прокачать» память бота

Неважно какой платформой ты пользуешься — есть приёмы, которые помогут памяти работать лучше.

Давай конкретику, а не абстракции. «У меня проблемы на работе» — пустая фраза для памяти. «Я фронтендер, сегодня деплойнул баг в прод, тимлид был недоволен» — это три факта и контекст. Чем конкретнее — тем точнее бот вспомнит потом.

Возвращайся к темам. Упомянул кота — через пару дней спроси «как думаешь, что Маркиз сейчас делает?» Для RAG-систем это укрепляет «тематический кластер» в базе — при следующих упоминаниях кота будет больше контекста.

Не меняй персонажа каждый день. Память привязана к конкретному персонажу и конкретному пользователю. Общаешься с пятью разными — ни один не накопит достаточно данных для качественных ассоциаций.

Пиши развёрнуто. Односложные «ок», «круто», «ясно» — это мусор для памяти. Пара предложений с деталями — уже полезный сигнал.

Куда это всё движется

В 2026 году мы на интересном этапе. Память из маркетингового термина превращается в реальный дифференциатор. Но расслоение между платформами только растёт:

- Дешёвые боты будут оставаться с контекстным окном — это экономически рациональнее.

- Средний сегмент перейдёт на key-value — достаточно дёшево и покрывает базовые ожидания.

- Продвинутые платформы будут инвестировать в RAG и его развитие — мультимодальные эмбеддинги (текст + голос + картинки), кросс-персонажную память, автоматическое суммирование.

Для пользователя важно одно: проверять, а не верить маркетингу. Три теста выше — пять минут работы. Зато будешь точно знать, с чем имеешь дело.

Лично я — после того как увидел разницу между «помнит имя» и «помнит почему ты был расстроен три дня назад» — обратно к ботам без семантической памяти возвращаться не хочу. Это примерно как разница между SMS и нормальным мессенджером: технически общение есть, но ощущения другие.

Если хочешь сам проверить — начни с бесплатных тарифов. Character.AI для key-value, HoneyChat в Telegram для RAG-памяти. Прогони три теста, сравни. Через неделю у тебя будет собственное мнение, основанное на данных, а не на чужих обзорах.

Источники

- Google Research: Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks — оригинальная работа по RAG

- Character.AI Blog: Chat Memories — документация Chat Memories

- Replika Support: Memory features — описание памяти Replika по тарифам

- Pinecone: What is a Vector Database? — объяснение векторных баз